Agosto 24, 2025

|13 minuti di lettura

Nel millisecondo necessario affinché una pagina web si carichi, si prende una decisione ad alto rischio che può definire la reputazione del tuo marchio. Quando il tuo annuncio B2B meticolosamente progettato appare, starà fianco a fianco a un’analisi di settore credibile in una rivista di settore? Oppure si materializzerà accanto a un sofisticato video deepfake di un CEO che diffonde disinformazione di mercato, proprio mentre un potenziale cliente sta svolgendo la due diligence sulla tua azienda? Un solo clic, una cattiva collocazione, e un accordo multimilionario potrebbe essere compromesso prima che il tuo team di vendita si accorga di cosa sia successo. Questa è la sfida centrale e ineludibile della pubblicità digitale moderna. L’Intelligenza Artificiale (IA) ha conferito ai marketer B2B un potere senza precedenti per targeting di precisione ed efficienza delle campagne. Tuttavia, questa lama a doppio taglio introduce anche nuove minacce complesse per la sicurezza del tuo marchio. Navigare in questo scenario richiede più di semplici strumenti difensivi: richiede una strategia proattiva e intelligente per proteggere il tuo bene più prezioso: l’integrità del tuo marchio. Cosa imparerai in questa guida

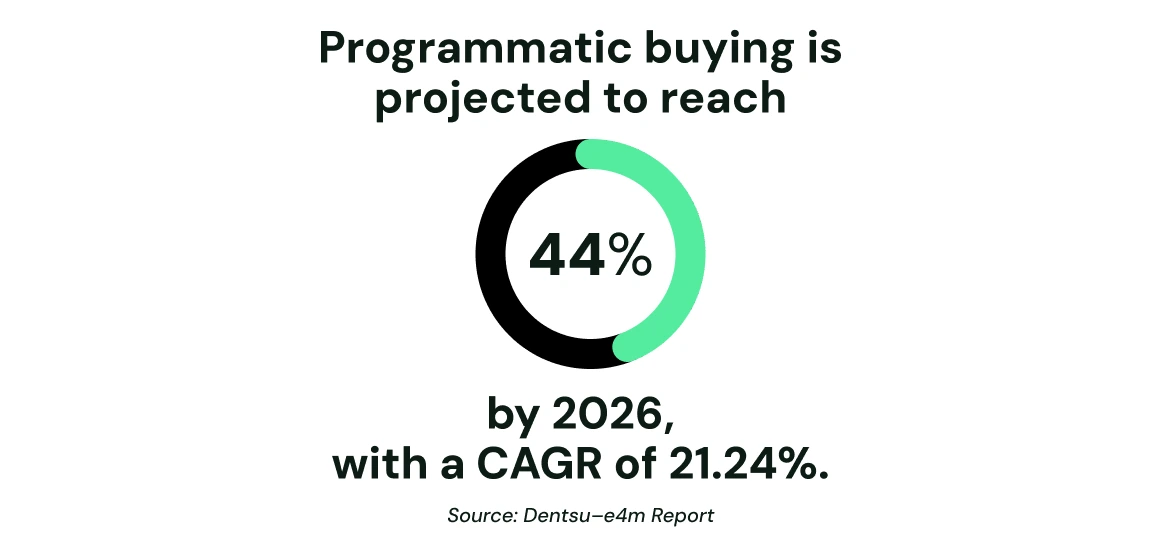

Non molto tempo fa, la sicurezza del marchio era un concetto semplice. I marketer facevano affidamento su whitelist di siti affidabili e su liste di parole chiave da vietare per evitare categorie universalmente non sicure come violenza, contenuti per adulti o discorsi d’odio. Ma questo approccio aveva difetti. Un marchio potrebbe bloccare la parola “crash” per evitare associazioni negative, rischiando però di perdere opportunità di apparire accanto a storie come “crashing the market with innovative technology.” Era uno strumento grezzo: gestibile, ma inefficiente. Poi arrivò la pubblicità programmatica. L’automazione dell’acquisto pubblicitario su milioni di siti web portò una notevole efficienza—ma a un costo. I marketer persero visibilità e controllo, poiché trilioni di aste pubblicitarie avvengono quotidianamente in una “scatola nera programmatica.” La supervisione manuale divenne impossibile. Questo spostamento da posizionamenti diretti a consegna guidata dagli algoritmi creò una nuova sfida di sicurezza del marchio: proteggere l’integrità del marchio in un ecosistema digitale imprevedibile e opaco.  Secondo il rapporto Dentsu-e4m, gli acquisti programmatici hanno rappresentato il 42% della spesa pubblicitaria digitale nel 2024—un aumento del 21% rispetto all’anno precedente. Questa crescita è destinata a continuare, con la quota di mercato programmatico prevista al 44% entro il 2026, crescendo a un CAGR del 21,24%. Con una porzione così ampia della spesa pubblicitaria mediata dagli algoritmi, i marchi cedono sempre più controllo su dove appaiono i loro annunci. In questa realtà, un approccio reattivo alla sicurezza del marchio non è più sufficiente. È essenziale un modello strategico orientato all’IA per mantenere l’integrità del marchio in un ecosistema automatizzato in rapida evoluzione.

Secondo il rapporto Dentsu-e4m, gli acquisti programmatici hanno rappresentato il 42% della spesa pubblicitaria digitale nel 2024—un aumento del 21% rispetto all’anno precedente. Questa crescita è destinata a continuare, con la quota di mercato programmatico prevista al 44% entro il 2026, crescendo a un CAGR del 21,24%. Con una porzione così ampia della spesa pubblicitaria mediata dagli algoritmi, i marchi cedono sempre più controllo su dove appaiono i loro annunci. In questa realtà, un approccio reattivo alla sicurezza del marchio non è più sufficiente. È essenziale un modello strategico orientato all’IA per mantenere l’integrità del marchio in un ecosistema automatizzato in rapida evoluzione.

Il panorama odierno richiede una shift da una mera sicurezza del marchio a una strategica idoneità del marchio. Per i B2B, dove la reputazione e la fiducia sono fondamentali per lunghi cicli di vendita e affari ad alto valore, questo è non negoziabile. Non basta più evitare contenuti inappropriati; l’obiettivo è trovare ambienti che rafforzino proattivamente l’esperienza e la credibilità. Usando IA avanzata per analizzare contesto e sentiment, i leader possono assicurarsi che il loro marchio appaia accanto a analisi di settore positive, non a rapporti su fallimenti aziendali. Questo trasforma la sicurezza del marchio da un mero centro di costo difensivo in un motore di prestazione, massimizzando il ROI assicurando che gli investimenti di marketing costruiscano fiducia con account di alto valore.

Per i marchi globali B2B, la sicurezza del marchio influisce sulla fiducia degli investitori, sulle relazioni con i partner e sulla fiducia dei clienti. Una pubblicità che appare accanto a notizie finanziarie false o contenuti polarizzanti può compromettere contratti a lungo termine e la percezione del mercato. La sicurezza del marchio moderna richiede strumenti alimentati dall’IA che valutino tono, emozione e allineamento ai valori, non solo la classificazione dei contenuti. Richiede integrazione tra marketing, legale e conformità per rafforzare la governance a ogni punto di contatto. Per i marketer aziendali, la domanda non è più “Come evitiamo contenuti negativi?” ma “Come ci allineiamo con i contenuti giusti, nel momento giusto, nel contesto giusto?” In un panorama mediatico affollato e volatile, la sicurezza del marchio non è più opzionale. È un differenziatore—e una prerequisito per la fiducia.

Nel mondo B2B, dove i lunghi cicli di vendita, gli accordi di alto valore e livelli profondi di fiducia sono fondamentali, un danno reputazionale derivante da una singola collocazione pubblicitaria errata può avere conseguenze finanziarie gravi e durature. Questa sfida è amplificata da un panorama digitale complesso che ora include social media, Connected TV (CTV) e Digital Out-of-Home (DOOH), con l’IA che diventa un motore per creare minacce nuove e sottili. Per i leader di marketing, il rischio è accresciuto da sfide moderne come disinformazione, la creazione scalabile di contenuti sintetici tramite IA generativa e un rapido cambiamento delle norme culturali. Queste minacce sono particolarmente difficili da gestire su team frammentati, molteplici agenzie e ambienti in rapido movimento. Tuttavia, il problema centrale è spesso interno: mancanza di responsabilità chiara e documentata su chi possiede i rischi della sicurezza del marchio e definisce livelli di tolleranza accettabili. Tecnologia e filtri IA da soli non possono risolvere questa lacuna di governance. Pertanto, la strategia consigliata è passare da un approccio rigido, puramente tecnologico, a un modello dinamico che combina strumenti avanzati con il giudizio umano esperto per navigare tra sfumature e contesto.

Il mondo B2B si fonda su competenza e fiducia. I contenuti generati dall’IA, specialmente i deepfake, attaccano direttamente questa base. Immagina un video deepfake di un analista di settore stimato che fa affermazioni negative sul tuo mercato, con la pubblicità della tua azienda per una soluzione correlata accanto ad esso. Questa associazione accidentale è dannosa immediatamente e può essere catturata dallo schermo e condivisa dai concorrenti. Questo rischio va oltre i video e include blog “esperti” generati dall’IA che promuovono dati difettosi o rapporti finanziari falsi progettati per manipolare la percezione del mercato. La minaccia è talmente significativa che le Nazioni Unite hanno chiesto misure globali più robuste per contrastare i contenuti deepfake prima che erodano la fiducia pubblica e aziendale (Reuters).

Gli algoritmi IA sono potenti, ma spesso mancano di una vera comprensione contestuale umana. Riconoscono parole chiave, non intenzioni. Questo porta a collocazioni inquietanti che possono danneggiare la tua reputazione. Considera un annuncio per il tuo software di sicurezza cloud che appare accanto a una grande notizia che dettaglia una grave violazione dei dati aziendali. Anche se le parole chiave corrispondono, il contesto fa apparire il tuo marchio fuori tono, inadeguato o persino predatorio, minando la credibilità della tua soluzione in un momento critico.

Per un pubblico aziendale sofisticato, la trasparenza è non negoziabile. Gli acquirenti B2B sono ricercatori; riescono a riconoscere una falsità a distanza. Se una società tecnologica B2B utilizzasse una testimonianza video interamente generata dall’IA da parte di un “cliente” che elogia la sua piattaforma, la scoperta da parte di acquirenti esperti sarebbe catastrofica. Le accuse di inganno distruggerebbero l’autenticità del marchio. Questo danno non è solo esterno; influisce sul morale dei dipendenti e sulla capacità di reclutare i migliori talenti desiderosi di lavorare per un’azienda in cui fidarsi. Nel B2B, recuperare da un deficit di fiducia è estremamente difficile.

Un enorme e insidioso drenaggio di budget di marketing proviene dai siti MFA di bassa qualità. Si tratta di siti generati algoritmicamente e pieni di contenuti rubati o rigirati, progettati per un solo scopo: raccogliere entrate pubblicitarie tramite canali programmatici. Spesso utilizzano pratiche ingannevoli come l’ad stacking (impilare più annunci uno sull’altro) e il pixel stuffing (riempire un pixel con annunci) per frodare gli inserzionisti. Uno studio di riferimento dell’Association of National Advertisers (ANA) ha rilevato che i siti MFA rappresentano un impressionante 15% della spesa pubblicitaria programmatica, sottraendo miliardi agli editori legittimi e a campagne di grande impatto in un “buco nero digitale.” 15% of programmatic ad spend, siphoning billions away from legitimate publishers and impactful campaigns into a “digital black hole.”

Le moderne piattaforme di sicurezza del marchio ora offrono un sistema di difesa multilivello che opera alla velocità della pubblicità programmatica, verificando le collocazioni degli annunci in tempo reale.

Le moderne piattaforme di sicurezza del marchio ora offrono un sistema di difesa multilivello che opera alla velocità della pubblicità programmatica, verificando le collocazioni degli annunci in tempo reale.

Questo va ben oltre le semplici parole chiave. Utilizzando l’elaborazione del linguaggio naturale (NLP), l’IA agisce come una lettrice ad alta velocità con una comprensione perfetta. Analizza il testo di una pagina per capire non solo l’argomento, ma anche il sentimento (positivo, negativo, neutro), il tono (ad es. clinico, satirico, arrabbiato) e la sfumatura del linguaggio. Contemporaneamente, la tecnologia di visione artificiale analizza immagini e fotogrammi video per individuare contenuti visivi non sicuri o inappropriati. Insieme, questi strumenti permettono di distinguere tra un reportage di Cronaca su una crisi aziendale e un articolo satirico su una rivista di business, assicurando che i tuoi annunci siano collocati in ambienti veramente idonei (Supermetrics).

I migliori strumenti IA lavorano in modo proattivo in millisecondi prima che l’annuncio sia nemmeno acquistato. Questo è noto come analisi pre-offerta. Prima che la tua piattaforma pubblicitaria effettui un’offerta per uno slot pubblicitario disponibile, l’IA di sicurezza analizza il contenuto della pagina, lo valuta rispetto alle regole di sicurezza e idoneità specifiche del tuo marchio, e blocca completamente l’offerta se l’ambiente comporta un rischio. Questo previene che il tuo annuncio appaia mai nel posto sbagliato.

Oltre al contenuto, l’IA è cruciale per rilevare frodi pubblicitarie. È addestrata a riconoscere la differenza tra comportamento umano e non umano. Può identificare schemi indicativi di botnet, frodi di clic (bot che generano clic falsi), frodi di impression (visite false) e spoofing del dominio (quando un sito di bassa qualità si spaccia per premium). Questo garantisce che il budget arrivi a reali audience aziendali, non a operazioni criminali.

Nonostante il suo potere, trattare l’IA come una soluzione da impostare e dimenticare è una ricetta per il fallimento. La tecnologia ha punti ciechi e limitazioni intrinseche che richiedono una gestione strategica.

Data la limitatezza dell’IA, la supervisione umana non è una funzione di eredità: è una componente strategica essenziale. Le aziende più intelligenti costruiscono un “Center of Excellence” per la sicurezza del marchio dove esperti umani guidano la tecnologia. Questo approccio “human-in-the-loop” è fondamentale per il successo. Questo team tipicamente include uno specialista Ad Ops, un analista dati, uno stratega del marchio e un esperto di policy. Questi strateghi umani forniscono il giudizio contestuale, il ragionamento etico e l’expertise settoriale che l’IA non possiede. Il loro compito non è rivedere ogni collocazione, ma gestire il sistema. Un solido processo di revisione umana comprende:

Il vertice della protezione del marchio va oltre il semplice evitare contenuti negativi per cercare attivamente l’ambiente perfetto. Questo è l’evoluzione cruciale dalla sicurezza del marchio all’idoneità del marchio (brand suitability). Dove la sicurezza del marchio fissa il pavimento (lo standard minimo assoluto da evitare), l’idoneità del marchio progetta l’intera casa (definendo il tono, il contesto e l’ambiente ideali per il tuo marchio). Questo approccio su misura allinea le collocazioni degli annunci ai tuoi valori e messaggi specifici. Per una società di cybersecurity, un articolo neutro sulla privacy dei dati potrebbe essere considerato “sicuro”, ma un’analisi approfondita delle minacce emergenti alla sicurezza aziendale è “idonea” — e molto più preziosa per raggiungere lo stato mentale del cliente ideale (Seekr). Sviluppare un quadro di idoneità è un esercizio strategico che coinvolge tre passaggi chiave:

Il panorama è in continua evoluzione, guidato da tre forze chiave:

L’Intelligenza Artificiale offre enormi opportunità per i marketer B2B, consentendo un livello di precisione e scalatura che una volta era impensabile. Ma genera anche rischi profondi per la valuta che conta di più nel business: fiducia e reputazione. Il successo non risiede nel scegliere tra innovazione e responsabilità, ma nel bilanciarli abilmente. Il futuro della pubblicità appartiene a chi impara a guidare la tecnologia, non a chi la segue. Combinando la potenza di strumenti IA sofisticati con la saggezza della supervisione umana—and elevando l’obiettivo da semplice sicurezza a una sicurezza olistica del marchio—puoi attraversare questa nuova frontiera con fiducia. Questo approccio non solo salvaguarderà la reputazione faticosamente conquistata del tuo marchio, ma costruirà anche una connessione più resiliente, autentica e redditizia con i tuoi clienti.

Please enter your email address so we can send you a one-time pass code and verify if you are an existing subscriber.